MVSep Woodwind — это высококачественная модель для разделения музыки на деревянные духовые инструменты и всё остальное. Список инструментов: гобой, саксофон, флейта, фагот, кларнет, флейта-пикколо, английский рожок, прочие деревянные духовые.

MVSep Woodwind — это высококачественная модель для разделения музыки на деревянные духовые инструменты и всё остальное. Список инструментов: гобой, саксофон, флейта, фагот, кларнет, флейта-пикколо, английский рожок, прочие деревянные духовые.

Волынка (Bagpipes) - это традиционный духовой музыкальный инструмент, известный своим характерным пронзительным и непрерывным звучанием.

Как она устроена:

Мешок (резервуар): Обычно изготавливается из кожи животных или современных синтетических материалов. Он служит для запаса воздуха.

Трубка для вдувания: Через неё музыкант ртом наполняет мешок воздухом (в некоторых разновидностях вместо этого используются небольшие меха, которые качают локтем).

Мелодическая трубка (чантер): Трубка с игровыми отверстиями, на которой музыкант перебирает пальцами, исполняя основную мелодию.

Бурдонные трубки (дроны): Одна или несколько трубок, которые издают постоянный, тягучий фоновый аккорд на одной ноте.

Главная особенность: Принцип игры заключается в том, что музыкант надувает мешок, а затем давит на него рукой, равномерно выталкивая воздух в звуковые трубки. Благодаря этому резервуару музыка не прерывается, даже когда исполнитель делает вдох.

Хотя волынка чаще всего ассоциируется с Шотландией (Great Highland Bagpipe) и кельтской культурой, её различные исторические вариации существуют по всей Европе, в Северной Африке и на Ближнем Востоке.

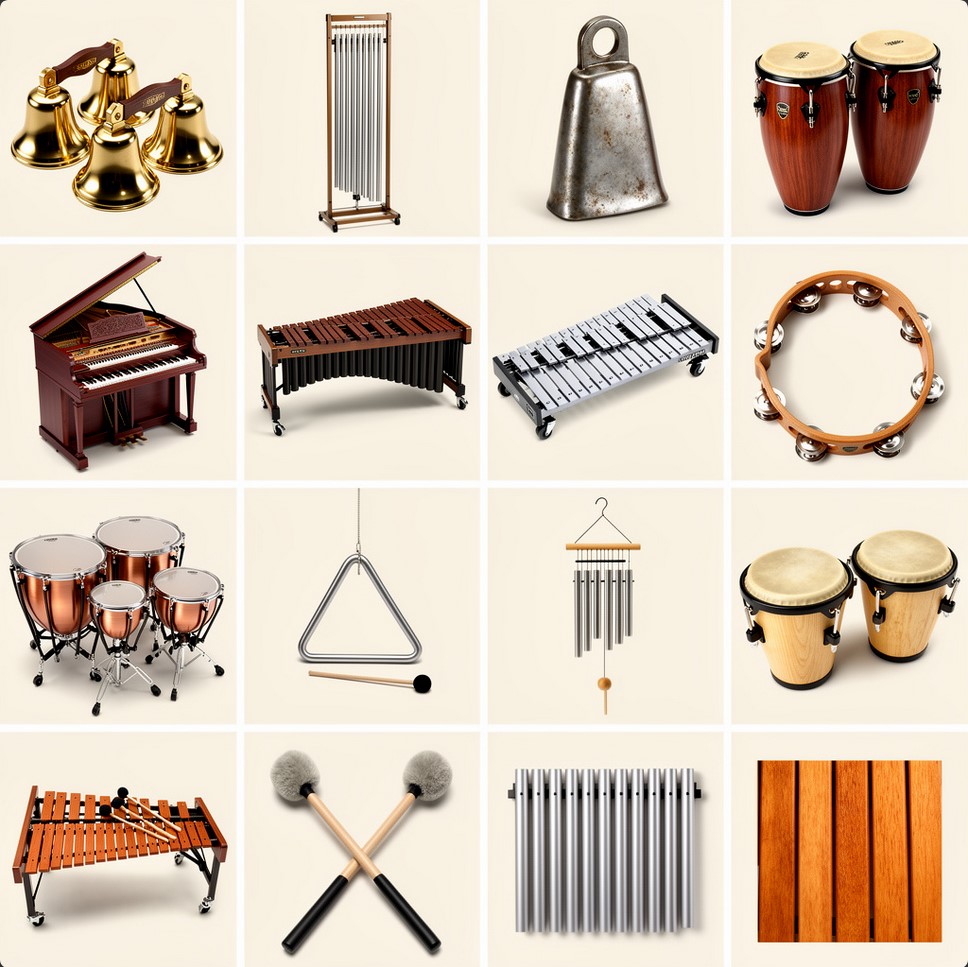

MVSep Percussion — это высококачественная модель для разделения музыки на перкуссию и всё остальное. Список инструментов: колокольчики, трубчатые колокола, коубелл, конги, челеста, маримба, глокеншпиль, бубен, литавры, треугольник, чаймс, бонги, хлопок, ксилофон, колотушки, металлические пластины, деревянные пластины.

Модель BandIt Plus для разделения треков на голос, музыку и эффекты. Она может быть полезна для телевизионных или кинематографических роликов. Модель была выложена авторами статьи "A Generalized Bandsplit Neural Network for Cinematic Audio Source Separation" в репозитории на GitHub. Модель была натренирована на наборе данных Divide and Remaster (DnR). И на данный момент имеет лучшие метрики качества среди подобных моделей.

Таблица качества

| Название алгоритма | DnR dataset |

||

| SDR Speech | SDR Music | SDR Effects | |

| BandIt Plus | 15.62 | 9.21 | 9.69 |

MVSep DnR v3 - это кинематографическая модель для разделения треков на 3 части: музыка, эффекты и диалоги. Она обучена на огромном мультиязыковом датасете DnR v3 и генерирует стемы speech, music и sfx. Метрики качества на проверочных данных получились лучше, чем у аналогичной мультиязыковой модели Bandit v2. Модель доступна в 3 вариантах: на базе архитектур SCNet, MelBand Roformer, а также ансамбль этих двух моделей. См. таблицу ниже:

| Название алгоритма |

Метрики качества в таблице лидеров DnR v3 |

||||

| music (SDR) | sfx (SDR) | speech (SDR) | |||

| SCNet Large | 9.94 | 11.35 | 12.59 | ||

| Mel Band Roformer | 9.45 | 11.24 | 12.27 | ||

| Ensemble (Mel + SCNet) | 10.15 | 11.67 | 12.81 | ||

| Bandit v2 (для сравнения) | 9.06 | 10.82 | 12.29 | ||

Braam (Браам) - это мощный кинематографический звуковой эффект (виртуальный инструмент), ставший абсолютным стандартом в современной музыке для кино и трейлеров.

Главные особенности:

Звучание: Это массивный, низкочастотный, раскатистый и часто агрессивный звук. Он напоминает апокалиптический гудок огромного корабля, тяжелый металлический скрежет или сигнал тревоги.

Происхождение: Этот звук приобрел массовую популярность после выхода фильма «Начало» (Inception, 2010) с музыкой Ханса Циммера, из-за чего его часто называют Inception Horn (гудок из «Начала»).

Как создается: Как правило, это результат сложного саунд-дизайна. Базой служат мощные низкие медные духовые (тромбоны, тубы, валторны). Затем их наслаивают на тяжелые синтезаторные басы и сильно обрабатывают эффектами: перегрузом (дисторшн), сатурацией и глубокой реверберацией.

Сегодня Braam существует в виде готовых сэмплов и библиотек для виртуальных синтезаторов (VST-плагинов), которые композиторы используют, чтобы мгновенно придать треку масштабность, напряжение или эпичность.

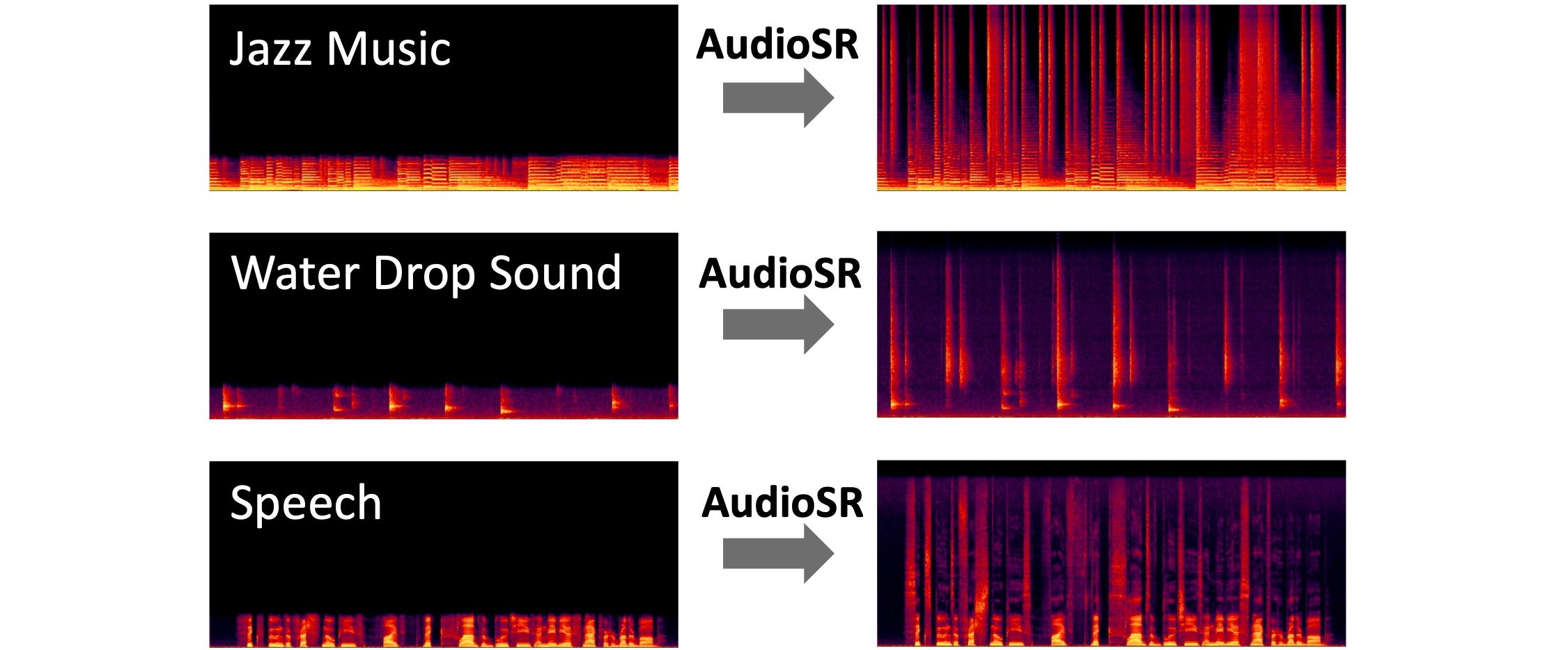

Алгоритм восстанавливает качество звука. Модель была предложена в этой статье и опубликована на github.

Доступны 3 модели:

1) MP3 Enhancer (автор JusperLee) - восстанавливает файлы MP3, сжатые с битрейтом 32 кбит/с до 128 кбит/с. Он не будет работать для файлов с большим битрейтом.

2) Universal Super Resolution (автор Lew) - восстанавливает более высокие частоты для любой музыки

3) Vocals Super Resolution (автор Lew) - восстанавливает более высокие частоты и общее качество для любого вокала

Набор различных моделей для удаления эффекта реверберации из музыки/вокала.

| Author | Architecture | Works with | SDR (no independent testing yet) | Link |

| FoxJoy | MDX-B | Full track | ~6.50 | |

| anvuew | MelRoformer | Only vocals | 7.56 | |

| anvuew | BSRoformer | Only vocals | 8.07 | |

| anvuew v2 | MelRoformer | Only vocals | --- | |

| Sucial | MelRoformer | Only vocals | 10.01 | |

| anvuew | BSRoformer | Only vocals (Room) | 13.74 | HF Link |

| anvuew | BSRoformer | Only vocals (Stereo) | 22.50 | HF Link |

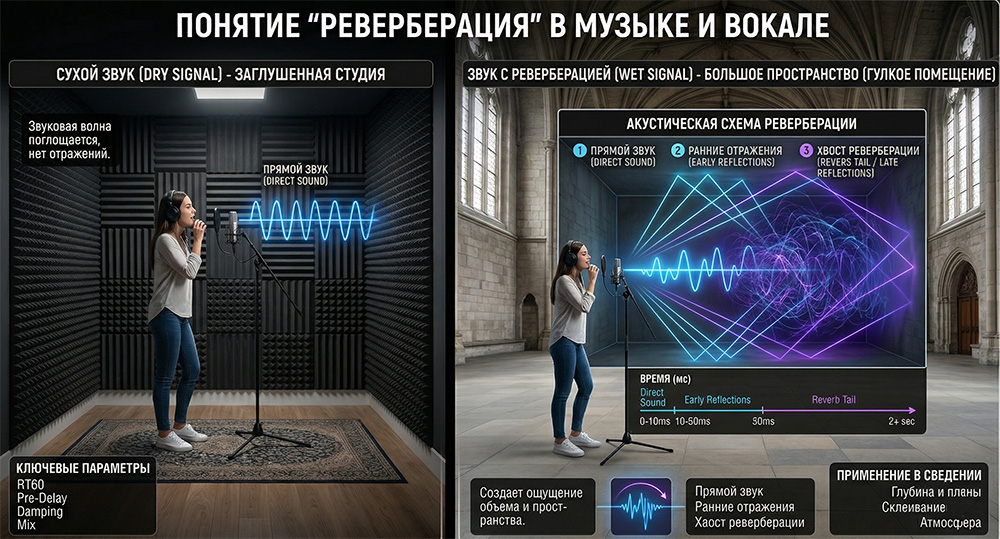

Реверберация (Reverb) - это физический процесс постепенного затухания звука в закрытом пространстве после того, как источник звука замолчал. Если обычное эхо - это отчетливые, раздельные копии звука (как крик в горах: "Ау... ау... ау"), то реверберация — это плотное, непрерывное гудящее облако из тысяч слившихся воедино отражений от стен, пола, потолка и других поверхностей (как звук хлопка в пустом соборе или на лестничной клетке).

В звукорежиссуре эффект реверберации используется для того, чтобы поместить сухой (записанный в студии) звук в какое-либо виртуальное пространство и придать ему объем.

Акустически этот процесс можно разделить на три этапа:

Прямой звук (Direct Sound): Звуковая волна, которая доходит до слушателя или микрофона по прямой линии, без каких-либо отражений. Это самый громкий и четкий сигнал.

Ранние отражения (Early Reflections): Первые отзвуки, которые отразились от ближайших поверхностей и достигли ушей спустя несколько миллисекунд после прямого звука. Именно они дают нашему мозгу информацию о том, в помещении какого размера и формы мы находимся.

Хвост (Late Reflections / Reverb Tail): Множество хаотичных, переплетающихся отражений, которые отскакивают от поверхностей снова и снова. Они сливаются в сплошной гул и постепенно теряют энергию (затухают).

Когда вы открываете плагин реверберации в DAW (цифровой звуковой рабочей станции), вы управляете физическими свойствами этого виртуального помещения:

Size / Room Size (Размер): Задает объем виртуального пространства (от крошечной кабинки до огромного стадиона).

Decay / Reverb Time / RT60 (Время затухания): Время (обычно в секундах), за которое хвост реверберации затухает на 60 децибел, то есть практически исчезает.

Pre-Delay (Предзадержка): Очень важный параметр, задающий паузу (в миллисекундах) между прямым звуком и началом реверберации. Увеличение Pre-Delay помогает отделить вокал или инструмент от "хвоста", сохраняя их разборчивость, но при этом оставляя ощущение большого пространства.

Damping (Демпфирование): Имитирует поглощение звука. В реальной жизни мягкие поверхности (ковры, люди, шторы) быстро поглощают высокие частоты, поэтому длинный хвост реверберации обычно звучит глуше прямого сигнала.

Mix / Dry/Wet (Баланс): Соотношение между исходным сухим сигналом (Dry) и обработанным (Wet).

Создание планов (глубина): Реверберация работает как ось Z (глубина) в миксе. Громкий и сухой звук кажется слушателю близким (прямо перед лицом), а тихий звук с большим количеством реверберации — далеким.

Склеивание микса: Если все инструменты записаны в разных заглушенных студиях, микс может звучать разрозненно. Отправка их на общую шину реверберации (даже в небольших количествах) помещает их в одно акустическое пространство.

Художественный эффект: Создание неземной, эмбиентной или эпичной атмосферы (например, эффект Shimmer, где хвост реверберации еще и поднимается на октаву вверх).

Удаление реверберации (или дереверберация) — это процесс очистки аудиосигнала от акустических отражений помещения, чтобы получить изначальный сухой (Dry) звук. Хотя реверберация делает звук красивым и объемным, во многих профессиональных сценариях этот эффект превращается в нежелательный шум или серьезное препятствие. Вот главные причины, почему возникает необходимость «высушить» звук:

Разделение музыкальных источников (Source Separation): При извлечении вокала или отдельных инструментов из готового стереотрека хвосты реверберации создают серьезную проблему — они «въедаются» в полезный сигнал. Эффективная дереверберация позволяет получить по-настоящему чистую акапеллу или стем инструмента, которые звучат так, будто их только что записали в студии, а не вырезали из концертного зала.

Системы автоматического распознавания речи (ASR): Эхо и гул помещения — злейшие враги акустических моделей. Отражения «размазывают» короткие согласные звуки и фонемы. В сложных задачах машинного обучения, таких как создание моделей распознавания детской речи, где артикуляция и без того часто бывает нечеткой, наличие реверберации катастрофически снижает точность транскрибации. Поэтому дереверберация является критически важным шагом предобработки аудио-датасетов.

Сэмплирование и ремикширование: Если вы берете вокальный сэмпл или барабанный луп со старой записи, он уже содержит пространство оригинального микса. Если добавить этот сэмпл в свой трек и наложить поверх него собственный, новый ревербератор, возникнет акустическая «грязь» (эффект реверберации на реверберации). Чтобы интегрировать чужой звук в свою архитектуру микса, его сначала нужно очистить.

Постпродакшн видео и кино (ADR & Location Sound): Речь актеров часто записывается микрофонами-пушками прямо на съемочной площадке (например, в гулкой пустой комнате или на лестничной клетке). Чтобы диалог звучал плотно, разборчиво и студийно, звукорежиссеру необходимо подавить естественные отражения локации.

Реставрация и форензика (криминалистика): Записи с камер наблюдения, скрытых микрофонов или диктофонов часто содержат столько комнатного гула, что слова становятся неразборчивыми. Подавление реверберации помогает восстановить читаемость речи.

Как это работает технологически? Раньше звукорежиссеры пытались бороться с комнатой с помощью гейтов (Noise Gate) и транзиент-шейперов (Transient Shaper), которые просто обрезали тихие хвосты звуков. Это работало грубо и часто искажало сам полезный сигнал. Сегодня задача дереверберации решается с помощью ИИ и нейронных сетей, которые обучены анализировать спектрограмму, отличать паттерны прямого сигнала от паттернов отражений и математически вычитать последние без ущерба для оригинала.

Алгоритм AudioSR: Универсальное масштабируемое аудио супер-разрешение. Алгоритм восстанавливает высокие частоты. Он работает со всеми типами аудио (например, музыка, речь, лай собаки, звук дождя и т.д.). Изначально он был обучен на монофоническом аудио, поэтому может давать нестабильные результаты на стерео.

Метрика на Super Resolution Checker for Music Leaderboard (Restored): 25.3195

Статья авторов: https://arxiv.org/pdf/2309.07314

Оригинальный репозиторий: https://github.com/haoheliu/versatile_audio_super_resolution

Оригинальный скрипт для вывода, подготовленный @jarredou: https://github.com/jarredou/AudioSR-Colab-Fork

FlashSR — алгоритм супер-разрешения аудио для восстановления высоких частот. Основан на статье FlashSR: One-step Versatile Audio Super-resolution via Diffusion Distillation.

Метрика на Super Resolution Checker for Music Leaderboard (Restored): 22.1397

Оригинальный репозиторий: https://github.com/jakeoneijk/FlashSR_Inference

Скрипт для инференса от @jarredou: https://github.com/jarredou/FlashSR-Colab-Inference

Генерация аудио по заданному текстовому запросу. Для генерации используется модель Stable Audio Open 1.0. Аудио генерируется в формате Стерео с частотой дискретизации 44.1 kHz длинной до 47 секунд. Качество довольно высокое. Запросы лучше делать на английском языке.

Примеры запросов:

1) Генерация отдельных звуков: cats meow, lion roar, dog bark

2) Генерация отдельных семплов: 128 BPM tech house drum loop

3) Генерация конкретных инструментов: A Coltrane-style jazz solo: fast, chaotic passages (200 BPM), with piercing saxophone screams and sharp dynamic changes

Whisper — это модель нейронной сети автоматического распознавания речи (ASR) и перевода речи от компании OpenAI. Модель имеет несколько версий. На MVSep мы используем самую большуюю и точную: «Whisper large-v3». Модель Whisper large-v3 была обучена на нескольких миллионах часов аудио. Это многоязычная модель, и она автоматически умеет определять язык текста. Чтобы применить модель к вашему аудио, у вас есть 2 варианта:

1) «Apply to original file» — это означает, что модель шепота будет применена непосредственно к отправленному вами файлу.

2) «Extract vocals first» — в этом случае перед использованием шепота сначала применяется модель BS Roformer для извлечения вокала. Она может удалить ненужный шум, чтобы улучшить качество работы Whisper.

У исходной модели были некоторые проблемы с таймингами транскрипции. Это было исправлено @linto-ai. Его вариант транскрипции доступен c опцией "New timestamps by linto-ai", но иногда этот метод может давать нежелательные артифакты. Оригинальный вариант таймингов доступен по опции "Old version of timestamps by whisper".

Более подробную информацию о модели можно найти здесь: https://huggingface.co/openai/whisper-large-v3 и здесь: https://github.com/openai/whisper

Parakeet — это семейство передовых моделей автоматического распознавания речи (ASR), разработанных NVIDIA совместно с Suno.ai. Эти модели построены на архитектуре Fast Conformer, созданной для обеспечения баланса между высокой точностью транскрипции и исключительной скоростью инференса. Они широко известны тем, что превосходят гораздо более крупные модели (такие как Whisper от OpenAI) по эффективности, сохраняя при этом конкурентоспособные или лучшие показатели ошибок слов (WER). Метрика качества WER: 6.03 в рейтинге Huggingface Open ASR.

MVSep предоставляет две версии модели (v2 и v3):

Страница модели v2: https://huggingface.co/nvidia/parakeet-tdt-0.6b-v2

Страница модели v3: https://huggingface.co/nvidia/parakeet-tdt-0.6b-v3

Выпущенная как высокоэффективная модель, ориентированная на английский язык, v2 утвердила Parakeet в качестве лидера по соотношению скорости и точности.

Выпуск v3 ознаменовал расширение эффективной архитектуры Parakeet с исключительно английского языка на многоязычную область без увеличения размера модели.

VibeVoice — это модель для генерации естественных разговорных диалогов из текста с возможностью использовать эталонный голос с целью его клонирования.

Нам нужно фонетическое разнообразие (все звуки языка) и живая интонация. Текст длиной около 35–40 слов при спокойном чтении как раз займет ~15 секунд.

Вот три варианта на английском под разные задачи:

Лучший выбор для общего использования. Содержит сложные звукосочетания для настройки четкости.

"To create a perfect voice clone, the AI needs to hear a full range of phonetic sounds. I am speaking clearly, taking small pauses, and asking: can you hear every detail? This short sample captures the unique texture and tone of my voice."

Для озвучки роликов, YouTube или блогов. Читайте живо, с улыбкой, меняя высоту голоса.

"Hey! I’m recording this clip to test how well the new technology works. The secret is to relax and speak exactly like I would to a friend. Do you think the AI can really copy my style and energy in just fifteen seconds?"

Для презентаций, аудиокниг или официальных сообщений. Читайте уверенно, немного медленнее, выделяя окончания слов.

"Voice synthesis technology is rapidly changing how we communicate in the digital age. It is essential to speak with confidence and precision to ensure high-quality output. This brief recording provides all the necessary data for a professional and accurate digital clone."

Pronunciation (Произношение): Старайтесь четко проговаривать окончания слов (особенно t, d, s, ing). Модели "любят" четкую артикуляцию.

Flow (Поток): Не читайте как робот. В английском важна мелодика (voice melody) — голос должен немного "плавать" вверх и вниз, а не звучать на одной ноте.

Breathing (Дыхание): Если вы делаете паузу на запятой или точке, не бойтесь сделать слышный вдох. Это добавит реализма клону.

VibeVoice (TTS) — это модель для генерации естественных разговорных диалогов из текста с возможностью создавать диалоги до 4 собеседников и длительностью до 90 минут.

Текст должен быть на английском или китайском языке, для других языков качество не гарантируется. Максимальная длина текста 5000 символов. Избегайте специальных символов. Текст должен быть оформлен в специальном формате с указанием говорящих:

Speaker 1: Hello! How are you today?

Speaker 2: I'm doing great, thanks for asking!

Speaker 1: That's wonderful to hear.

Speaker 3: Hey everyone, sorry I'm late!

Hello! How are you today?

I'm doing great!Важно:

Speaker N: (где N — номер от 1 до 4)Speaker 1: = speaker 1: = SPEAKER 1Если вам нужен монолог, то спикера можно не указывать.

Монолог (1 говорящий):

Speaker 1: Today I want to talk about artificial intelligence.

Speaker 1: It's changing our world in incredible ways.

Speaker 1: From healthcare to entertainment, AI is everywhere.Диалог (2 говорящих):

Speaker 1: Have you tried the new restaurant downtown?

Speaker 2: Not yet, but I've heard great things about it!

Speaker 1: We should go there this weekend.

Speaker 2: That sounds like a perfect plan!Групповая беседа (3-4 говорящих):

Speaker 1: Welcome to our podcast, everyone!

Speaker 2: Thanks for having us!

Speaker 3: It's great to be here.

Speaker 4: I'm excited to share our thoughts today.

Speaker 1: Let's start with introductions.Qwen3-TTS — это мощная модель генерации речи, предлагающая поддержку клонирования голоса, дизайна голоса, создания сверхкачественной человекоподобной речи и управления голосом на естественном языке. Она предоставляет разработчикам и пользователям самый широкий набор функций генерации речи. На MVSep мы используем самую большую модель с 1,7 млрд параметров.

Страница оригинальной модели: https://github.com/QwenLM/Qwen3-TTS

Qwen3-TTS (Custom Voice) предлагает набор из 9 предустановленных дикторов. Дополнительно вы можете указать «Voice description» (описание голоса), добавив эмоции, например «happy voice» (счастливый голос) или «sad voice» (грустный голос). Вы также можете выбрать язык для этой модели или оставить значение «auto».

Qwen3-TTS — это мощная модель генерации речи, предлагающая поддержку клонирования голоса, дизайна голоса, создания сверхкачественной человекоподобной речи и управления голосом на естественном языке. Она предоставляет разработчикам и пользователям самый широкий набор функций генерации речи. На MVSep мы используем самую большую модель с 1,7 млрд параметров.

Страница оригинальной модели: https://github.com/QwenLM/Qwen3-TTS

Qwen3-TTS (Voice Design) предлагает начитать текст произвольным голосом, который можно подробно описать в поле «Voice description» (описание голоса). Можно указать пол и возраст диктора, добавить эмоции, например «happy voice» (счастливый голос) или «sad voice» (грустный голос). Вы также можете выбрать язык для этой модели или оставить значение «auto».

Qwen3-TTS — это мощная модель генерации речи, предлагающая поддержку клонирования голоса, дизайна голоса, создания сверхкачественной человекоподобной речи и управления голосом на естественном языке. Она предоставляет разработчикам и пользователям самый широкий набор функций генерации речи. На MVSep мы используем самую большую модель с 1,7 млрд параметров.

Страница оригинальной модели: https://github.com/QwenLM/Qwen3-TTS

Qwen3-TTS (Voice Cloning) позволяет загрузить референсный аудиофайл, чтобы озвучить заданный текст голосом из образца. Для повышения качества клонирования вы можете дополнительно указать расшифровку аудио в поле «Reference text in audio». Вы также можете выбрать язык для этой модели или оставить значение «auto».

Bark — это созданная компанией Suno модель на базе архитектуры трансформеров, которая представляет собой не просто традиционный инструмент синтеза речи, а полноценную генеративную систему класса «текст в аудио». Её возможности выходят далеко за рамки обычного озвучивания: помимо создания высокореалистичной речи на множестве языков, Bark умеет генерировать музыку, фоновые шумы и простые звуковые эффекты. Уникальной особенностью модели является способность воспроизводить тонкие невербальные коммуникации, такие как смех, вздохи и плач, что делает итоговое звучание максимально живым и естественным.

Стремясь поддержать сообщество, разработчики открыли доступ к предварительно обученным контрольным точкам, которые готовы к работе и разрешены даже для коммерческого использования. Тем не менее важно учитывать, что Bark создавался в первую очередь для исследовательских задач. Будучи полностью генеративной моделью, она может вести себя непредсказуемо и иногда отклоняться от введенных текстовых подсказок.

Официальный репоизторий модели: https://github.com/suno-ai/bark

В отличие от классических TTS-систем, Bark не использует SSML-разметку. Вместо этого он обучен распознавать определенные текстовые вставки (теги) как инструкции для генерации звуков.

Все управляющие команды пишутся в квадратных скобках. Важно: Сами теги должны быть написаны на английском языке, даже если основной текст, который вы генерируете, на русском, испанском или любом другом языке.

Синтаксис:

Текст до эффекта [тег_эффекта] текст после эффекта.

Bark официально распознает следующий набор токенов для невербальных звуков:

| Тег | Описание | Пример использования |

[laughter] |

Громкий, явный смех | Привет! [laughter] Как же это было смешно. |

[laughs] |

Короткий смешок, хихиканье | Ну да, конечно [laughs]. |

[sighs] |

Тяжелый вздох (усталость, облегчение) | [sighs] Я так устал от этой работы. |

[music] |

Вставка инструментальной музыки | [music] (играет фоновая музыка) |

[gasps] |

Резкий вдох (испуг, удивление) | [gasps] Я не ожидал тебя здесь увидеть! |

[clears throat] |

Откашливание (привлечение внимания) | [clears throat] Господа, прошу внимания. |

Примечание: Также существуют вариации [man laughs] и [woman laughs], но они работают стабильнее всего, если пол спикера (Speaker History) совпадает с тегом.

Чтобы заставить модель «пропеть» текст, а не прочитать его, используются музыкальные ноты.

Метод: Оберните текст в символы музыкальных нот ♪ (Shift + Alt + V на Mac или Alt+13 на Win, или просто скопируйте).

Пример: ♪ In the jungle, the mighty jungle, the lion sleeps tonight ♪

Совет: Это работает лучше всего, если вы используете английский язык, так как обучающий датасет содержал много английских песен, но на русском тоже можно добиться результата.

Хотя специальных тегов для пауз (типа

Двоеточие и тире (..., —): Используйте многоточие или длинное тире для создания пауз, колебаний или заминок в речи.

Пример: Я... я не уверен, что это правильно.

CAPS LOCK: Иногда (не гарантированно) написание слова ЗАГЛАВНЫМИ БУКВАМИ может добавить ударение или повысить громкость.

Вероятностная природа: Bark — это GPT для аудио. Если вы напишете [laughter], модель с высокой вероятностью сгенерирует смех, но иногда она может проигнорировать тег или сгенерировать странный звук.

Контекст имеет значение: Тег [laughter] сработает естественнее после шутки, чем посреди трагического предложения. Модель «понимает» семантику текста.

Шепот (Whispering): Официального тега [whisper] нет. Однако сообщество заметило, что добавление слов типа "quietly" или использование специфических спикеров (Speaker Prompts) иногда помогает, но это метод проб и ошибок.

Ограничения на сайте: в данный момент все отправленные тексты обрезаются до 1000 символов.

MVSep MultiSpeaker (MDX23C) — данная модель пытается изолировать самый громкий голос от всех остальных голосов. Модель основана на архитектуре MDX23C. Все еще в разработке.

Алгоритм добавляет к вокалу эффект «шепота». Модель создана SUC-DriverOld. Подробнее здесь.

Модель Aspiration отделяет:

Слышимое дыхание

Шипение и жужжание фрикативных согласных (например, «с» и «ф»)

Взрывные согласные: глухой взрывной звук, возникающий при произнесении согласных (таких как "п", "т", "к").

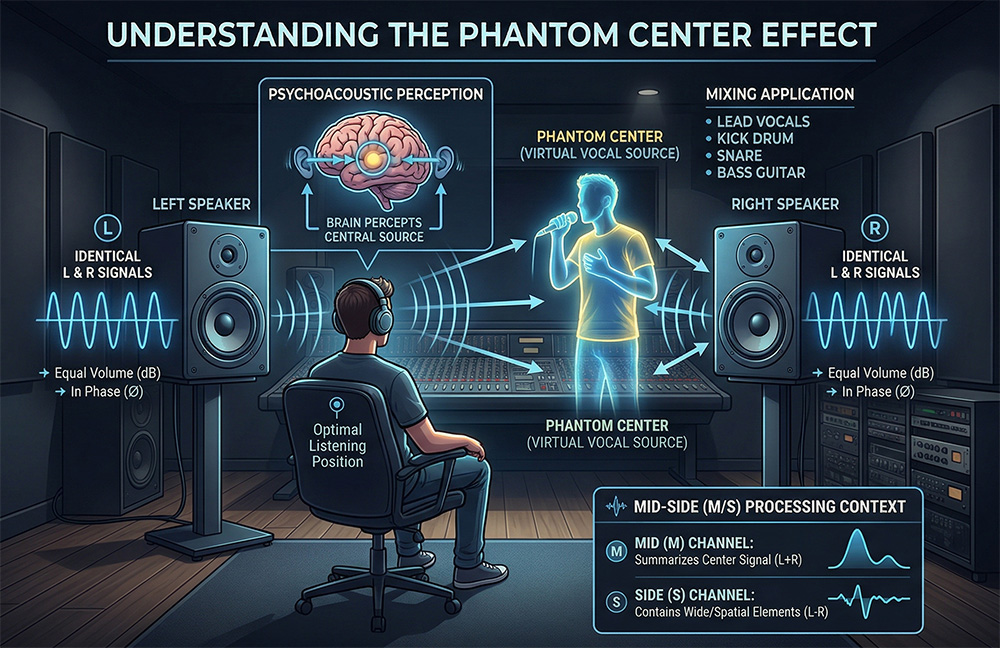

Слушая музыку в стерео, мы часто отчетливо слышим вокал, звучащий прямо перед нами. Но если вы посмотрите на свою акустическую систему, то увидите лишь две колонки по бокам. Источника звука посередине нет. То, что вы слышите — это фантомный центр.

Как это работает? Фантомный центр — это психоакустическая иллюзия. Она возникает, когда левый и правый каналы воспроизводят один и тот же моно-сигнал с абсолютно одинаковой громкостью и в одинаковой фазе. Наш мозг обрабатывает звук, приходящий в оба уха одновременно, и "дорисовывает" виртуальный источник звука прямо по центру.

Фундамент микса: Традиционно в центр помещают самые важные и "энергоемкие" элементы трека. Главный вокал, бас-гитара, бочка (kick) и малый барабан (snare) панорамируются строго в ноль (по центру). Это гарантирует, что энергия низких частот равномерно распределяется на оба монитора, делая микс пробивным и плотным.

Контраст и ширина: Фантомный центр служит точкой отсчета для всего остального микса. Широкие стереоэффекты, дабл-треки гитар или объемные синтезаторы звучат широко именно благодаря контрасту с плотным и узким фантомным центром.

Mid/Side обработка: В современных технологиях мастеринга и извлечения стемов (source separation) фантомный центр часто выделяют в отдельный канал — Mid (середина), который вычисляется как сумма левого и правого каналов. Это позволяет эквализировать или изолировать вокал и ритм-секцию, не затрагивая инструменты, звучащие по краям (Side).

Опасности фантомного центра Эта иллюзия очень хрупкая. Если сигнал в одном из каналов задержится хотя бы на миллисекунду или его фаза будет нарушена, центр "поплывет" или вовсе исчезнет из-за фазового вычитания. Поэтому при работе со стереорасширителями всегда важно проверять трек на моносовместимость.

У нас на данный момент доступно два алгоритма извлечения фантомного центра. Ниже приведены их метрики качества полученные на валидационном датасете:

| Model | Center SDR | Center L1Freq | Center fullness | Center bleedless |

| Phantom Centre by wesleyr36 (MDX23C) | 8.25 | 27.52 | 19.44 | 38.92 |

| Phantom Centre by gilliaan (BSRoformer) | 16.45 | 44.00 | 37.17 | 48.76 |

Matchering — это новый инструмент для сопоставления и мастеринга аудио. Он основан на простой идее: вы берете ДВА аудиофайла и загружаете их в Matchering:

Алгоритм сопоставляет оба этих трека и предоставляет вам обработанный трек TARGET с теми же значениями RMS, частотной характеристики, пиковой амплитуды и ширины стереобазы, что и у трека REFERENCE.

Основано на коде @sergree.

SOME (Singing-Oriented MIDI Extractor) — это инструмент для извлечения MIDI, способный конвертировать пение в MIDI-последовательность. Модель была обучена исключительно на китайском вокале, поэтому с другими языками она может работать некорректно.

Оригинальная страница: https://github.com/openvpi/SOME

Transkun — это современная open-source модель для автоматической транскрипции фортепианной музыки (Audio-to-MIDI). Официальная страничка модели: здесь. Она считается одной из лучших (SOTA — State of the Art) в своем классе. Модель умеет распознавать не только сами ноты, но и их длительность, громкость (velocity) и использование педали. В отличие от многих старых моделей, которые анализируют музыку «покадрово» (frame-based), Transkun использует подход Neural Semi-CRF (semi-Markov Conditional Random Field). Вместо того чтобы спрашивать «звучит ли нота в эту миллисекунду?», модель рассматривает события как цельные интервалы (от начала до конца ноты). В последних версиях используется Transformer (Non-Hierarchical Transformer), который вычисляет вероятность того, что определенный отрезок времени является нотой. Декодинг: Используется алгоритм Витерби (Viterbi) для поиска наиболее вероятной последовательности непересекающихся интервалов. Модель показывает отличные результаты на датасете MAESTRO (стандарт индустрии).

Basic Pitch — это современная нейросеть от исследовательской лаборатории Spotify (Audio Intelligence Lab), которая переводит любые мелодические аудиозаписи в ноты (формат MIDI). В отличие от устаревших конвертеров, эта модель умеет «слышать» не только отдельные ноты, но и аккорды, а также тончайшие нюансы исполнения. Официальная страница модели: https://github.com/spotify/basic-pitch

Basic Pitch — это «инструментально-агностическая» модель. Это значит, что она одинаково хорошо справляется с разными тембрами:

- Вокал: Напойте мелодию в микрофон, и нейросеть превратит ваш голос в партию для синтезатора.

- Струнные: Акустическая и электрогитара, скрипка, виолончель.

- Клавишные: Фортепиано, рояль, органы и синтезаторы.

- Духовые: Флейта, саксофон, труба и другие.

Важно: Модель предназначена для мелодических инструментов. Она не подходит для распознавания ударных (барабанов и перкуссии), так как фокусируется на высоте тона, а не на ритмическом шуме.

HeartMuLa — это передовое семейство мультимодальных базовых моделей (Foundation Models) с открытым исходным кодом (лицензия Apache 2.0), предназначенное для высококачественного синтеза музыки и работы со звуком. В отличие от проприетарных облачных сервисов (таких как Suno или Udio), HeartMuLa предоставляет разработчикам полный контроль над процессом генерации и возможность локального запуска на собственном оборудовании. Модель работает на базе LLM-архитектуры и позволяет создавать полноценные композиции по текстовым промптам.

Официальный репозиторий: https://github.com/HeartMuLa/heartlib

Мультиязычная генерация вокала: Поддерживается синтез речи и пения на нескольких языках, включая английский, китайский, японский, корейский и испанский.

Тонкий структурный контроль: Использование специальных тегов в текстах (например, [Intro], [Verse], [Chorus], [Bridge]) позволяет точно управлять аранжировкой и развитием композиции.

Управление музыкальными атрибутами: Модель отлично понимает комплексные описания. Вы можете задавать жанр (рок, джаз, R&B, метал), тембр (dark, bright, soft), эмоции и конкретные инструменты.

В текущей базовой версии HeartMuLa полноценная поддержка русского языка не заявлена.

Для вокала (тексты песен): Модель официально оптимизирована для работы только с пятью языками: английским, китайским, японским, корейским и испанским. Если передать ей текст на кириллице, результат «из коробки», скорее всего, будет нестабильным — от сильного акцента и искажения слов до полной фонетической бессмыслицы.

Для промптов (описание музыки): Задавать жанр, настроение, структуру и инструменты (теги) также нужно строго на английском языке. Встроенный модуль выравнивания (HeartCLAP) обучался на англоязычных датасетах, поэтому русские описания он просто не поймет.

Система не является монолитной; это комплекс из нескольких специализированных нейросетей, объединенных в единый пайплайн обработки аудио:

HeartCodec (Нейрокодек): Основа системы — токенизатор музыки, работающий на экстремально низкой частоте (12.5 Гц). Он обеспечивает высочайшую точность реконструкции сигнала (high fidelity) при минимальном объеме данных. Это критически важно для того, чтобы языковая модель могла эффективно генерировать длинные аудиофрагменты в авторегрессионном режиме.

HeartCLAP: Модель выравнивания текста и звука (audio-text alignment). Она создает единое пространство эмбеддингов, благодаря которому текстовое описание "грустная мелодия на акустической гитаре" математически точно сопоставляется с нужными акустическими характеристиками.

HeartTranscriptor: Модуль на базе архитектуры Whisper, дообученный специально для транскрибации текстов песен и извлечения фонетических признаков из вокала.

Генератор HeartMuLa: Основная LLM-модель с трехуровневой архитектурой:

Глобальный backbone обрабатывает текстовые токены и аудиокодировки.

Локальный декодер отвечает за непосредственный синтез музыки на основе скрытых состояний.

Детокенизатор переводит сгенерированные токены обратно в непрерывную звуковую волну (waveform).

Для обучения использовалась стратегия мульти-энкодера: модель извлекает данные из предобученных сетей Whisper, WavLM и собственного MuEncoder, что позволяет анализировать звук одновременно на фонетическом, семантическом и акустическом уровнях.

Важное примечание: В целях соблюдения этики ИИ, согласно технической документации разработчиков, в сгенерированные треки встраивается невидимый цифровой водяной знак (watermark) для идентификации машинного происхождения аудио.

При работе с ИИ-моделями для генерации музыки текст (лирика) выполняет две функции: он говорит модели, что петь, а мета-теги в квадратных скобках [...] указывают, как это петь и как выстраивать структуру трека. Модель воспринимает теги как режиссерские указания.

Эти теги разбивают сплошной текст на логические музыкальные блоки. Их нужно писать с новой строки перед блоком текста.

[Intro] — Вступление. Задает настроение и темп до начала вокала. Под этим тегом обычно не пишут текст, либо добавляют короткие атмосферные фразы или вокализы (например, Ooh-ooh).

[Verse] (или [Verse 1], [Verse 2]) — Куплет. Здесь раскрывается история. Музыка в куплетах обычно более спокойная, а ритм — ровный. Использование нумерации помогает модели понять, что мелодия должна повторяться, но текст будет новым.

[Pre-Chorus] — Предприпев. Переходная часть, где нарастает напряжение и плотность инструментов перед главной кульминацией.

[Chorus] — Припев. Главная мысль и самая запоминающаяся мелодия. Здесь модель обычно выдает максимум эмоций, плотности звука и вокальной экспрессии.

[Bridge] — Бридж (мост). Вставляется ближе к концу песни (обычно после второго припева). В этой части кардинально меняется мелодия, ритм или тональность, чтобы песня не казалась монотонной.

[Outro] — Кода (завершение). Плавное затухание музыки (fade-out) или красивый финальный аккорд.

Вы можете управлять не только структурой, но и аранжировкой в конкретные моменты времени.

Соло и проигрыши: Используйте теги вроде [Guitar Solo], [Piano Interlude], [Bass Drop] или [Drum Fill] между куплетами и припевами. Текст под ними писать не нужно.

Вокальные указания: Если модель это поддерживает, можно задавать стиль исполнения перед строкой: [Whisper], [Scream], [Spoken], [Choir].

Бэк-вокал и эхо: Чтобы добавить бэк-вокал или хоровые ответы, заключайте слова в круглые скобки. Например: Lead: Walking down this lonely road Backing: (lonely road)

Даже с идеальными тегами ИИ может запутаться, если сам текст плохо структурирован.

Симметрия и ритмика: ИИ-модели опираются на количество слогов. Постарайтесь, чтобы строки в одном куплете имели примерно одинаковое количество слогов и четкий размер. Если одна строка состоит из 5 слов, а следующая из 15 — модель начнет "жевать" слова или сломает ритм.

Пунктуация — это дыхание: Запятые , и точки . работают как паузы. Если вам нужно, чтобы вокалист взял дыхание или сделал паузу перед важным словом, поставьте запятую. Отсутствие знаков препинания заставит ИИ петь скороговоркой.

Язык: Как мы обсуждали ранее, пишите тексты строго на английском языке (или другом официально поддерживаемом), чтобы избежать фонетического "мусора" и акцента.

Разделение: Обязательно оставляйте пустую строку (перенос) между разными блоками (между куплетом и припевом).

Вот как должен выглядеть грамотно составленный промпт для генерации:

[Intro][Verse]You could, you could take me to a place that's new,A wave or a cloud, holding hands with only you.You could, you could tell me that you have it all,Everything I wanted, catching me before I fall.

[Chorus]Take me out for a ride,Along the docks or in the wood,You could make me sick inside,In just a single word you could.

[Chorus]The sky would think it's right,It loves the simple things,My heart against yours tight,If you love the simple things.No, let's not do what others doNo, let's not do what others doLa, lalala, lalalaIf you love the simple thingsLa, lalala, lalala, lalala la la la

[Verse]You could, you could take me out to eat somewhere,The finest of tables, honestly I do not care.You could, you could use your charms to make me yield,Step right up to me and make me drop my shield.

[Chorus]Take me out for a ride,Along the docks or in the wood,You could make me sick inside,In just a single word you could.

[Chorus]The sky would think it's right,It loves the simple things,My heart against yours tight,If you love the simple things.No, let's not do what others doNo, let's not do what others do

[Bridge]Take me my boy, let me take a little bite,Behind a deep feeling hides a man of great might.Make me fly my boy, tell me if we are alright,Behind a deep feeling hides a man of great might.

[Chorus]Take me out for a ride,Along the docks or in the wood,You could make me sick inside,In just a single word you could.

[Chorus] The sky would think it's right,It loves the simple things,My heart against yours tight,If you love the simple things.La, lalala, lalalaIf you love the simple thingsLa, lalala, lalalaLa la la la la la la

Это руководство основано на анализе научной статьи по HeartMuLa (разделы 3.2 и 6.2). Модель использует токенизатор естественного языка (Llama 3), а не фиксированный словарь. Для достижения стабильной генерации выбирайте теги из 8 основных категорий, которые использовались при обучении.

Каждая категория имеет процент важности, отражающий «вероятность выбора» во время обучения.

Частота при обучении: Теги «семплировались» (выбирались) в процессе обучения. Жанр включался в 95% случаев, тогда как Инструмент — только в 25%.

Ожидания модели: Для корректной работы модель ожидает наличие тега жанра. Без него генерации не хватает четкого структурного якоря.

Влияние и стабильность: Более высокий процент означает большую стабильность. Тег с вероятностью 95% (Жанр) — это «сильный якорь», тогда как тег с 10% (Тема) — это «слабая подсказка», которая может быть проигнорирована, если она конфликтует с более сильными тегами.

Стратегия: Для максимального контроля активно опирайтесь на 4 топовые категории (Жанр, Тембр, Пол, Настроение). Используйте теги с низким процентом только как «приправу» после того, как задана основная структура.

GENRE / ЖАНР (95% — ОБЯЗАТЕЛЬНО)

Примеры: Pop, Rock, Electronic, Hiphop, Jazz, Classical, Techno, Trance, Ambient.

TIMBRE / ТЕМБР (50% — Текстура звука)

Примеры: Soft, Warm, Husky, Bright, Dark, Distorted.

GENDER / ПОЛ ВОКАЛИСТА (37% — Характер вокала)

Примеры: Male, Female.

MOOD / НАСТРОЕНИЕ (32% — Эмоциональный вайб)

Примеры: Happy, Sad, Energetic, Joyful, Melancholic, Relaxing, Dark.

INSTRUMENT / ИНСТРУМЕНТ (25% — Доминирующие звуки)

Примеры: Piano, Synthesizer, Acoustic Guitar, Electric Guitar, Bass, Drums, Strings, Violin.

SCENE / СЦЕНА (20% — Контекст прослушивания)

Примеры: Dance, Workout, Dating, Study, Cinematic, Party.

REGION / РЕГИОН (12% — Культурное влияние)

Примеры: K-pop, Latin, Western.

TOPIC / ТЕМА (10% — Лирическая тема)

Примеры: Love, Summer, Heartbreak.

Для удобства все 8 категорий и возможные теги для них вынесены в отдельные опции выбора на сайте. Вы можете не указывать их и ввести свой набор тегов в строке Tags (otional).

Чтобы сохранить сильный якорь и избежать «интерференции вероятностей», не используйте конфликтующие теги.

Семантический конфликт: Запрос «Rock, Jazz» рассеивает внимание модели, что часто приводит к «грязи» или невыразительным, шаблонным аранжировкам.

Стабильность якоря: Один сильный якорь дает четкую карту действий. Несколько жанров создают конфликтующие карты, из-за чего ИИ теряет фокус.

Рекомендация: Выбирайте только один тег для каждой категории. Будьте точны, избегайте слишком широких понятий.

Используйте список, разделенный запятыми.

Примеры:

Electronic, Techno, Synthesizer, Dark, High Energy, Club

Pop, Piano, Female, Sad, Soft, Love, Acoustic

Экспериментальная модель VitLarge23 на базе Vision Transformers. По метрикам немного уступает MDX23C, но может сработать лучше в некоторых случаях.

Таблица качества

| Algorithm name | Multisong dataset | Synth dataset | MDX23 Leaderboard |

||

| SDR Vocals | SDR Instrumental | SDR Vocals | SDR Instrumental | SDR Vocals | |

| Vit Large 23 (512px) v1 | 9.78 | 16.09 | 12.33 | 12.03 | 10.47 |

| Vit Large 23 (512px) v2 | 9.90 | 16.20 | 12.38 | 12.08 | --- |

Mel Band Roformer - модель предложенная сотрудниками компании ByteDance для конкурса Sound Demixing Challenge 2023, где они заняли первое место на LeaderBoard C. К сожалению, модель не была выложена в открытый доступ и была воспроизведена по научной статье разработчиком @lucidrains на площадке github. Вокальная модель была обучена с нуля на нашем внутреннем датасете. К сожалению, нам пока не удалось достичь аналогичных метрик как у авторов.

Таблица качества

| Algorithm name | Multisong dataset | Synth dataset | MDX23 Leaderboard |

||

| SDR Vocals | SDR Instrumental | SDR Vocals | SDR Instrumental | SDR Vocals | |

| Mel Band Roformer v1 (vocals) | 9.07 | --- | 11.76 | --- | --- |

Модель LarsNet производит разделение дорожки барабанов на 5 типов: 'kick', 'snare', 'cymbals', 'toms', 'hihat'. Используется модель из репозитория на github и обученная на датасете StemGMD. Модель имеет два режима работы. В первом (по умолчанию) сначала к треку применяется модель Demucs4 HT, которая извлекает из трека только барабанную часть. Далее уже применяется модель LarsNet. Если ваш трек состоит только из барабанов, то имеет смысл использовать второй режим, где модель LarsNet применяется непосредственно к загруженному аудио. К сожалению, субъективно качество разделения уступает по качеству модели DrumSep.